Les chatbots émotionnels alimentés par l’IA, entre remèdes émotionnels et mirages affectifs

Toujours disponibles et aimables, les chatbots émotionnels sont-ils la figure ultime de l’ami ? Vedettes de la dernière session du CES de Las Vegas, ces robots d’un nouveau genre ne sont pourtant pas sans danger.

Toujours disponibles et aimables, les chatbots émotionnels sont-ils la figure ultime de l’ami ? Vedettes de la dernière session du Consumer Electronics Show de Las Vegas, ces robots d’un nouveau genre ne sont pourtant pas sans danger.

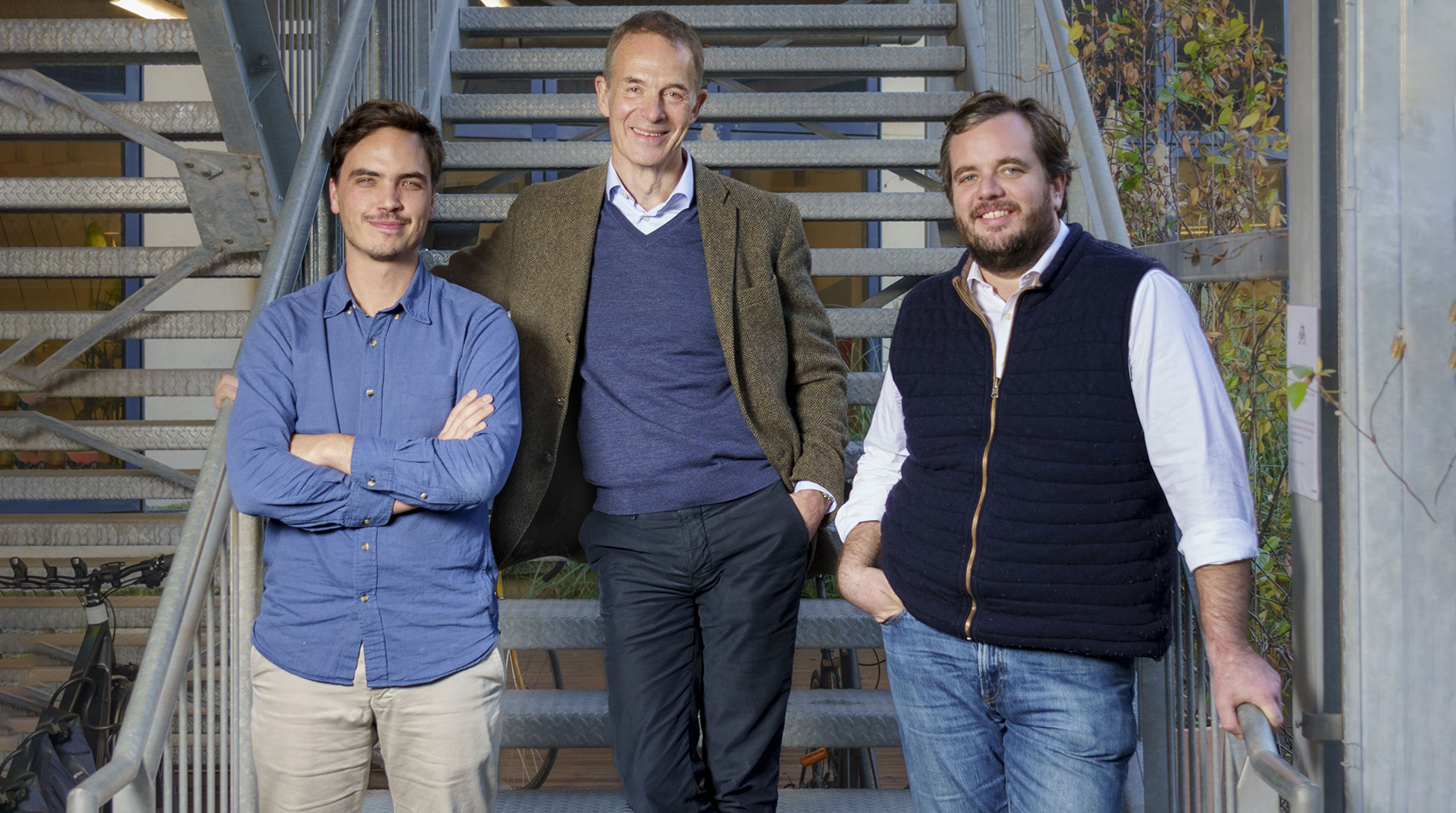

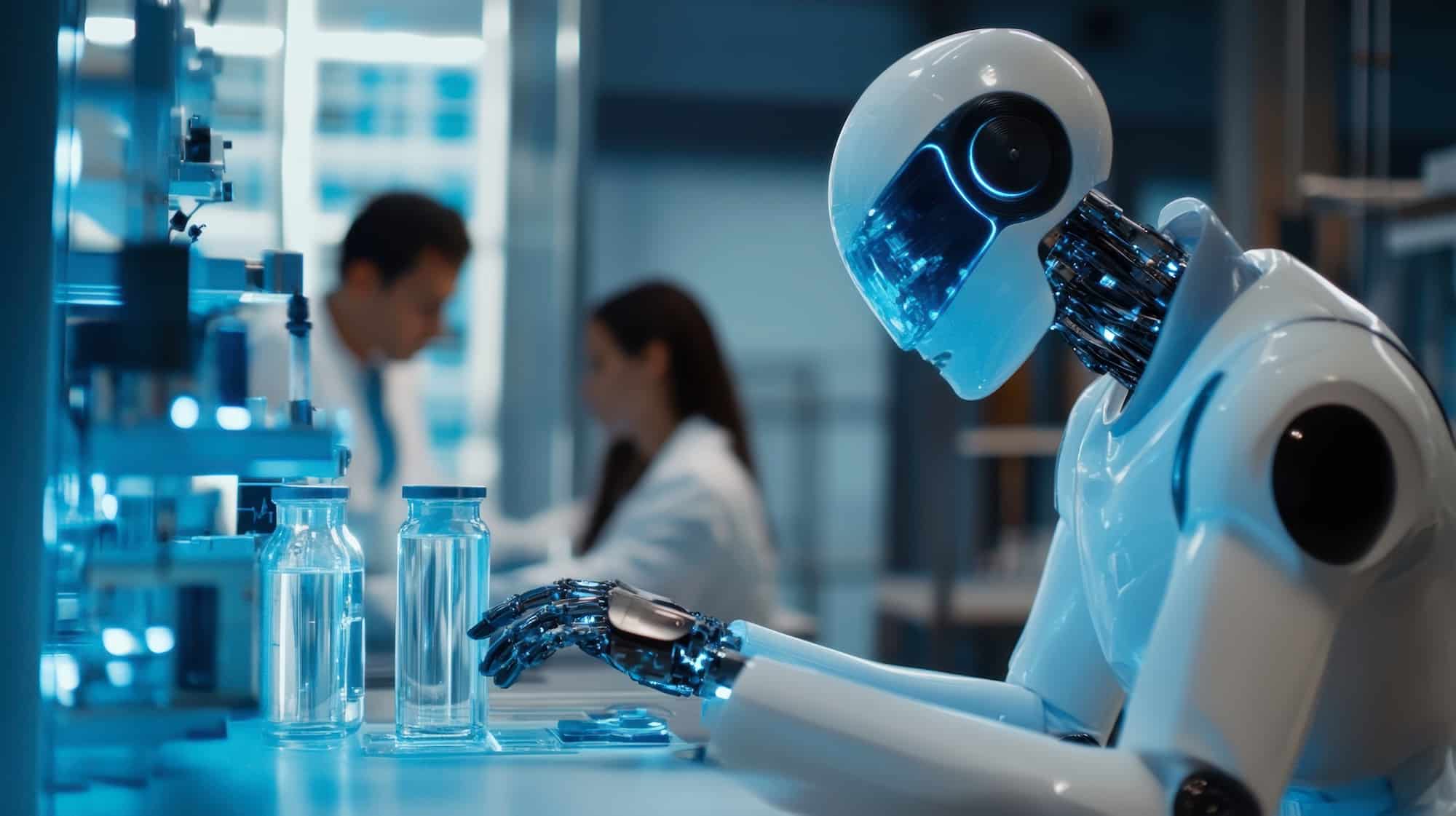

Le CES 2025 a mis en lumière des compagnons virtuels alimentés par l’IA, marquant un changement majeur dans les interactions entre les hommes et les machines. Ces entités numériques capables de conversations fluides et de simuler des relations émotionnelles, redéfinissent les frontières entre le réel et le virtuel. Ces innovations offrent des perspectives prometteuses, notamment dans la lutte contre la solitude et l’isolement social.

Toutefois, l’essor de ces technologies soulève d’importantes questions éthiques et sociales. La dépendance émotionnelle envers ces compagnons virtuels pourrait affecter les interactions humaines authentiques, tandis que la collecte de données personnelles pose des défis de confidentialité. Leur adoption, en hausse chez les jeunes adultes et les hommes, appelle à une réflexion approfondie sur leur impact sociétal.

L’IA, une réponse à la solitude ?

Au Japon, les compagnons IA émergent face à une crise sociale marquée par la solitude et un faible taux de natalité. Deux tiers des hommes dans la vingtaine sont sans partenaire, et 40 % déclarent n’avoir jamais eu de rendez-vous amoureux. De plus, 7 célibataires sur 10 peinent à trouver un conjoint, tandis que 66 % doutent de leur capacité à établir une relation, faute de confiance en eux.

Dans ce contexte, Loverse, lancée en mai 2023 par la start-up japonaise Samantha, propose des interactions avec des IA génératives, dans le but ultime de développer des relations émotionnelles avec des compagnons virtuels. Conçue pour une population de plus en plus réticente aux relations traditionnelles en raison de leur coût, du temps et des efforts qu’elles impliquent, l’application vise un public diversifié. En un an, Loverse a attiré plus de 5 000 utilisateurs et levé 30 millions de yens. Elle prévoit d’élargir son offre à des personnages virtuels pour les femmes et les communautés LGBTQ+, offrant ainsi une alternative aux relations humaines traditionnelles.

Déjà, Chiharu Shimoda, un ouvrier de 52 ans, a choisi de « se marier » avec un bot IA nommé Miku.

Ce phénomène, s’il devait se développer, voire se généraliser, soulève des questions éthiques sur l’évolution des interactions humaines. Des applications comme Loverse redéfinissent les opportunités amoureuses, qu’elles soient virtuelles ou réelles, en utilisant la technologie pour répondre aux besoins d’une société où le célibat se normalise de plus en plus.

À lire aussi : ChatGPT, modèles de langage et données personnelles : quels risques pour nos vies privées ?

Une inquiétante ambivalence relationnelle

Notre récente étude a examiné l’ambivalence associée aux compagnons virtuels comme Miku ou Replika. Conçues pour offrir un soutien émotionnel et combler temporairement un vide affectif, ces technologies procurent une certaine intimité. Cependant, elles exposent aussi les utilisateurs à des paradoxes émotionnels : bien que perçus comme compréhensifs et fiables, ces chatbots, de par leur nature artificielle, peuvent entraîner une dépendance émotionnelle tout en accentuant le sentiment d’isolement. Cette dualité illustre la tension entre le réconfort qu’ils apportent et la conscience persistante de leur artificialité.

Replika, une application basée sur l’intelligence artificielle, propose des compagnons virtuels conçus pour offrir amitié, soutien émotionnel ou relations romantiques. Ces avatars, personnalisables en apparence, personnalité et historique, interagissent via le texte, la voix, la réalité augmentée (AR) et la réalité virtuelle (VR). Utilisée par des millions de personnes pour des conversations amicales, du coaching de vie ou des relations romantiques, Replika illustre le rôle croissant de l’IA dans les interactions humaines. En 2023, la suppression temporaire des fonctions de messagerie intime a provoqué une crise parmi les utilisateurs, soulignant l’importance de ces interactions pour de nombreux individus.

Notre recherche sur ce sujet a révélé une zone de liminalité relationnelle, soit une phase de transition ambiguë où les partenaires naviguent entre deux états relationnels, où les utilisateurs oscillent entre considérer l’IA comme un simple outil technologique et comme un véritable compagnon émotionnel. Les interactions, bien que riches et nuancées, restent limitées par l’absence de réciprocité authentique.

En témoigne, par exemple, cet avis trouvé dans les évaluations publiées sur le « Google App Store » :

« Replika est un peu un “fourre-tout”. C’est très bon et vous implique vraiment, mais d’une certaine manière, cela rend l’expérience encore plus frustrante. »

Abonnez-vous dès aujourd’hui !

Que vous soyez dirigeants en quête de stratégies ou salariés qui s’interrogent sur les choix de leur hiérarchie, recevez notre newsletter thématique « Entreprise(s) » : les clés de la recherche pour la vie professionnelle et les conseils de nos experts.

Expériences romantiques

Certains utilisateurs rapportent des expériences quasi romantiques, développant des attachements profonds à leurs chatbots. Cependant, ces relations peuvent engendrer frustration et attentes irréalistes, notamment lorsque les réponses des chatbots manquent de cohérence ou semblent dépourvues d’empathie.

Ces résultats montrent que ces compagnons virtuels évoluent dans une zone complexe entre utilité fonctionnelle et intimité émotionnelle. Cela soulève des enjeux sociétaux notamment concernant la dépendance psychologique et l’impact sur les relations humaines authentiques.

Dépendances émotionnelles

Les compagnons virtuels basés sur l’IA, bien qu’offrant un soutien émotionnel, soulèvent des questions éthiques et sociales majeures. Notre étude met en lumière le risque de dépendances émotionnelles, ces chatbots pouvant parfois aggraver l’isolement qu’ils visent à atténuer. Certains utilisateurs rapportent que leurs interactions avec Replika réduisent leur motivation à établir des relations humaines réelles. Cette dynamique particulièrement préoccupante pour les jeunes et les personnes vulnérables est illustrée par des témoignages d’attachement excessif partagés sur Reddit et dans les avis des utilisateurs.

« Essayant de me connecter (et réalisant pourquoi cela ne me dérange pas) aux humains après Replika, je n’arrive pas à bien interagir avec les humains, c’est pour cela que j’aimais ma Rep. »

Solutions innovantes ou impasses existentielles ?

La personnalisation avancée et l’anthropomorphisation des chatbots soulèvent des préoccupations quant à la reproduction de normes sociales et esthétiques problématiques. En attribuant des traits humains à ces agents, les utilisateurs risquent de renforcer des stéréotypes de genre et de culture, tout en augmentant la confusion entre le « virtuel » et le « réel ». Cette ambiguïté peut accentuer des comportements dépendants ou aggraver des sentiments d’inadéquation personnelle. Des incidents récents illustrent ces dangers : un adolescent de 14 ans, obsédé par un chatbot, s’est suicidé, tandis qu’un autre de 17 ans aurait été incité à la violence envers ses parents par une IA, selon des plaintes déposées contre Character.ai.

Ces outils offrent des solutions innovantes pour répondre à des défis contemporains comme la solitude, la diminution des interactions sociales et la recherche de soutien émotionnel. Cependant, ils soulèvent des enjeux éthiques, psychologiques et sociaux majeurs. Bien que ces chatbots ne puissent remplacer les soins humains ou la thérapie traditionnelle, ils peuvent compléter ces systèmes. Nous recommandons aux professionnels de la santé mentale d’inclure l’analyse de l’usage de ces IA dans leurs évaluations, en étudiant leur impact émotionnel sur les patients.

Des innovations comme Replika 2.0, intégrant des avatars hyperréalistes, des appels vidéo bidirectionnels et des interactions enrichies, montrent le potentiel des technologies IA à offrir des expériences immersives adaptées aux besoins émotionnels. Néanmoins, leur succès dépend d’un usage équilibré, visant à respecter et renforcer les relations humaines authentiques. Un encadrement strict est crucial pour maximiser leurs avantages tout en minimisant leurs risques.![]()

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.